Les scientifiques de l’Université de Berkeley en Californie, touchent du doigt la science-fiction. Grâce à une technologie d’imagerie médicale de pointe et un modèle mathématique intégré à une simulation par ordinateur, ils sont parvenus à reconstruire (approximativement) des vidéos à partir d’images stockées dans le cerveau humain. Cette découverte ouvre la voie de la reproduction vidéo sur écrans de nos rêves et souvenirs.

Dans le passé, les chercheurs avaient déjà réussi à dire avec exactitude l’image en noir et blanc que regardait un sujet grâce à un modèle de calcul et à la mesure de l’activité cérébrale dans le cortex visuel (la partie du cerveau chargée de traiter les informations visuelles).

Dans cette dernière expérience, les scientifiques ont surmonté des problématiques bien plus difficiles en décodant les signaux émis par le cerveau lors du visionnage d’images animées. Le but est de comprendre comment le cerveau humain traite des images dynamiques.

Imaginez vous promener en vidéo dans l’esprit d’un patient dans le coma ou même télécharger vos rêves les plus fous sur votre chaîne YouTube…

Pour le moment, cette technologie dont l’éthique est discutable, ne permet de reconstruire que des vidéos que le sujet a déjà visionnées.

Pour parvenir à réaliser cet exploit scientifique, les chercheurs ont utilisé l‘Imagerie par Résonance Magnétique Fonctionnelle (IRMF) et des modèles mathématiques extrêmement complexes. Ils ont fait visionner par des personnes des bandes-annonces de films Hollywoodiens et ont réussi à décoder grâce à l’IRM le fonctionnement du cerveau puis à reconstruire dynamiquement l’expérience visuelle du sujet.

L’enregistrement IRMf de l’activité cérébrale lors du visionnage des vidéos a été introduit dans un programme informatique « maison » qui a appris seconde par seconde, à associer ces signaux cérébraux à un modèle visuel correspondant. Ces modèles visuels ont été obtenus en échantillonnant seconde par seconde l’activité cérébrale des sujets ayant visionné une bibliothèque de 18 millions de secondes de vidéos YouTube qui ne comprend pas les bandes-annonces utilisées comme stimulation dans l’expérience. Grâce à ce travail, la technologie est en mesure d’associer un échantillon visuel à une stimulation cérébrale correspondante. En fait, les films sont reconstruits dans l’esprit à partir d’évocations d’échantillons d’images analogues.

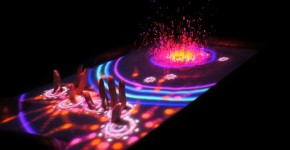

Comme vous pourrez le voir dans la vidéo ci-dessous, le résultat de cette expérience donne une reconstruction floue du film visionné. Les formes et les couleurs sont reconstruites mais les détails peuvent différer.

Cette technologie pourrait nous permettre de mieux comprendre ce qu’il se passe dans l’esprit des gens qui ne peuvent pas ou difficilement communiquer verbalement. Cette découverte pourrait également constituer la première brique de nouvelles interfaces cerveau-machine permettant aux personnes paralysées de pouvoir contrôler des appareil avec leur esprit.

N’ayez pas peur ou pas encore… ![]() les scientifiques sont encore loin de pouvoir lire dans vos pensées et décoder votre inconscient pour le projeter sur un écran. Pour les agents secret ? Le sérum de vérité a encore de beaux jours devant lui…

les scientifiques sont encore loin de pouvoir lire dans vos pensées et décoder votre inconscient pour le projeter sur un écran. Pour les agents secret ? Le sérum de vérité a encore de beaux jours devant lui…

Lire la news de l’Université de Berkeley

Pour en savoir plus : The Gallant Lab at UC Berkeley

Via Presse Citron

Image à la une FSEF