Après le fameux Kinect de Microsoft et l’outsider LeapMotion qui permettent de contrôler par gestes, sans manettes, des jeux vidéo ou des applications sur console ou PC, voici Umoove, une nouvelle technologie qui pourrait démocratiser le contrôle par gestes sur mobile.

Mise au point par la start-up israélienne Umoove, cette technologie explore une nouvelle façon d’interagir avec un smartphone ou une tablette. Oubliez les interactions tactiles, avec Umoove il suffit de hocher la tête et de cligner des yeux pour contrôler votre appareil mobile.

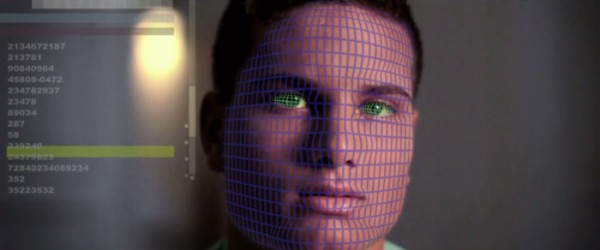

Umoove est capable de suivre en temps réel les mouvements de votre visage (face-tracking) et de vos yeux (eye-tracking) en utilisant la caméra frontale de votre appareil mobile.

Pour démontrer tout le potentiel de cette nouvelle technologie, Umoove à lancé un petit jeu mobile gratuit baptisé « Umoove Flying Experience », dans lequel vous pourrez explorer une carte en trois dimensions et réaliser quelques actions en faisant uniquement des mouvements de la tête face à votre mobile ou votre tablette. Pour avoir testé cette app, le résultat est bluffant. La navigation est simple, intuitive et assez précise.

Umoove mettra bientôt un SDK à disposition des éditeurs d’applications qui leur permettra de libérer leur imagination et de créer de nouvelles apps ou de nouveaux jeux intégrant cette technologie de contrôle par mouvements de la tête et des yeux.

Bientôt disponible sur l’App Store d’Android, cette application peut d’ores et déjà être testée gratuitement sur l’App Store d’Apple.

Ce qui peut être problématique avec le contrôle par le regard est lié à ce qui différencie l’utilisation courante de l’utilisation en mode laboratoire ou démo, c’est à dire la gestion de l’intentionnalité… surtout sur la durée. Ce problème doit exister ici, même s’il est moins aigu que dans le pilotage par la pensée.

On peut cligner ou bouger les yeux (c’est à dire agir sur l’interface) sans vouloir y attacher une action particulière. C’est un problème général: plus l’interaction à la machine est simple, moins l’intention est lisible… plus les intentions doivent être limitées en nombre…

… ou alors il faut les mixer avec des principes de commande plus “intentionnels“.